该文章由【吐司创造营】直播的部分脚本编成,部分操作向和演示向内容无法用文本撰写,故推荐配合回放观看效果更佳。部分观点来源网络,如有错误欢迎指正!

本期文章对应回放为👉:BV1Vt421j7hc

概念

本质上是dreambooth的内容,通过添加额外的约束和惩罚项,来改进学习算法的表现,以减少过度拟合问题,能提高模型的泛化能力。正则化是一种先验知识。就像临摹字帖,提前学习数据,让AI知道它的训练范围在哪儿。

好处

避免了过拟合可能会带来的各种崩坏情况;

给机器一个参考图片,机器就会根据参考图片去学习;

提高模型的精准度

数据集质量不高或者数量少,就需要正则化来限制模型的复杂程度,避免过拟合

正则化图片的选取原则

正则化图片放训练集以外的内容但是和原训练集有某些共通之处

图片数量一般多余数据集

不需要打标

训练细节且原本模型里面体现不出来的特征

相同底模,对想泛化的特征出图

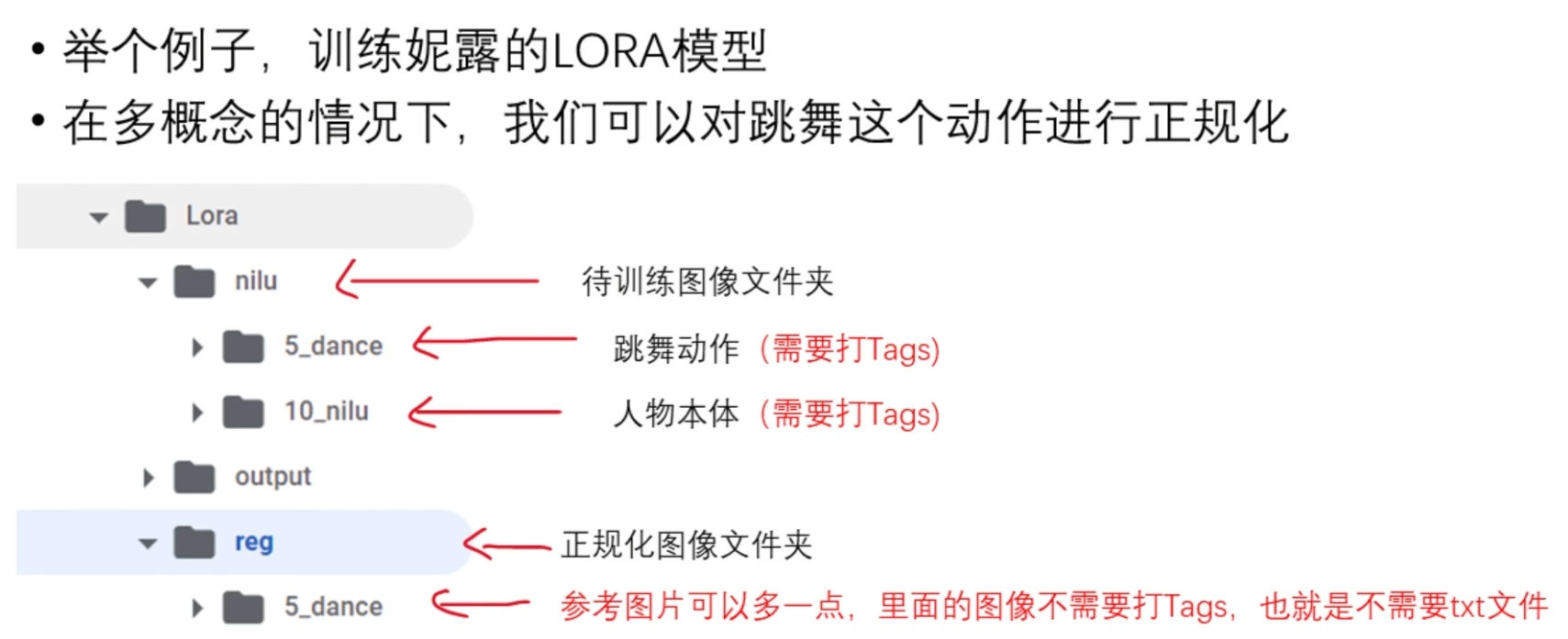

多类型lora的详细用法

多合一lora:通过不同触发词来调用

强调面部特征

10_face

10_body

多服装进一个lora

10_reddress

10_bluedress

强调姿势

5_dance

10_body

功能性lora:加强特征

加强某个关键词的特征,让他更稳定效果更好,如果prompt词里面出现了正则化里的关键词,则效果会被放大

正则化 - 先验损失权重 prior_loss_weight:默认1,正则本身的影响权重,1的话代表你在正则里放的图片和训练集里图片的权重是一样的,你的正则100%影响你的训练集

dim和alpha尽量小一点,让原本画风对他的污染效果变低

手动正则法:泛化特征,在少量数据集的情况下使用

数据集更少的情况下可以使用镜像翻转,数据集不足势必要在更多地方花更多的时间。比如粗略的用1张图出lora,然后通过lora出图再作为训练集进行下一步的训练。通过控制repeat数可以控制三个文件夹中图片的权重。

原因:不适用系统正则是因为图片少,正则的权重不好控制,不如直接调控repeat

内容:

4-5张各种姿势,内容可以通用。

使用nsfw的内容可以不污染服装,脸部需要涂黑(遮罩)并且绑定在faceless上,只要不输入faceless是不会出现黑块的。

保证reg文件夹中的图片数×repeat等于或略微大于body文件夹中的图片数×repeat 、

tag原则

发色瞳色等简单特征全部删除

为头部 、上半身、下半身、脚分别设置触发词

细节,头饰、纹身之类的建议保留

补充

locon:随机洗像素,也是提高泛化性的一个手段,不用卷积会更偏向原数据集的图片,缺点是人物姿势比较固定,比较适合炼画风,更有随机性。

卷积和正则化都是降低模型的拟合度增加模型的泛化性,让模型更有随机性,不适合人物的训练。